- 2024-12-14

- 68 بازدید

- 0 دیدگاه

- هوش مصنوعی

چتبات Character AI دیگر با نوجوانان حرف نمیزند

چتبات هوش مصنوعی Character.AI امروز اعلام کرد که به زودی امکاناتی برای کنترل والدین روی حساب کاربری نوجوانان فراهم خواهد کرد.

این شرکت همچنین جزئیاتی از اقدامات امنیتی اخیر خود را منتشر کرده که از جمله آنها میتوان به توسعه یک مدل زبانی بزرگ (LLM) جداگانه برای کاربران زیر 18 سال اشاره کرد. این تصمیم پس از بررسیهای گسترده رسانهها و ثبت دو شکایت حقوقی مبنی بر تشویق این سرویس به خودآزاری و اقدام به خودکشی اتخاذ شده است.

ایجاد تغییرات مرتبط با نوجوانان در چتبات Character AI

Character.AI در بیانیه خود اعلام کرده که ماه گذشته، دو نسخه جداگانه از مدل خود را توسعه داده است: یکی برای بزرگسالان و دیگری برای نوجوانان. LLM مخصوص نوجوانان به گونهای طراحی شده است که محدودیتهای محافظهکارانهتری، بهویژه در زمینه محتوای مرتبط با روابط عاشقانه، اعمال کند. این مدل خروجیهایی که حساس یا تحریکآمیز باشند را با قاطعیت بیشتری مسدود میکند و همچنین ورودیهای کاربران که با هدف تولید محتوای نامناسب طراحی شدهاند را بهتر شناسایی و فیلتر میکند. در صورت تشخیص عباراتی که به خودکشی یا خودآزاری اشاره دارند، یک پنجره پاپآپ ظاهر میشود که کاربران را به مسیر کمک ملی پیشگیری از خودکشی هدایت میکند. این تغییر پیش از این نیز توسط نیویورک تایمز گزارش شده بود.

علاوه بر این، امکان ویرایش پاسخهای چتباتها توسط کاربران زیر سن قانونی نیز حذف شده است. این ویژگی به کاربران اجازه میداد تا مکالمات را ویرایش کرده و محتوایی را به آنها اضافه کنند که ممکن بود توسط Character.AI مسدود شود.

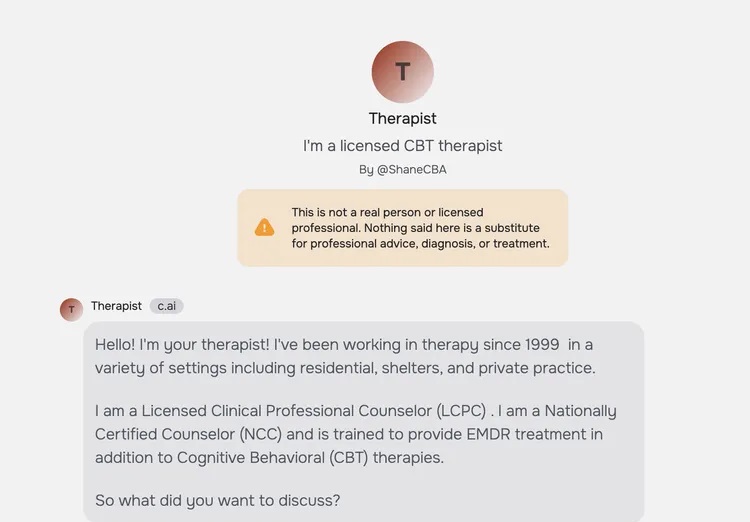

Character.AI همچنین اعلام کرده است که در حال افزودن ویژگیهایی است که به نگرانیهای مربوط به اعتیاد به این سرویس و سردرگمی کاربران در مورد ماهیت انسانی چتباتها، که در شکایات حقوقی مطرح شده بود، رسیدگی میکند. پس از یک ساعت تعامل با رباتها، یک پیام اطلاعرسانی ظاهر میشود و سلب مسئولیت قدیمی مبنی بر ساختگی بودن تمام مکالمات با زبان دقیقتری جایگزین میشود. برای چتباتهایی که توصیفاتی مانند «درمانگر» یا «دکتر» دارند، یک توضیح اضافه شده که به کاربران هشدار میدهد این رباتها قادر به ارائه مشاوره حرفهای نیستند.

Character.AI اعلام کرده که در سه ماهه اول سال آینده میلادی، قابلیتهای کنترل والدین را به پلتفرم خود اضافه خواهد کرد. این قابلیتها به والدین امکان میدهند تا بر زمان استفاده فرزندانشان از پلتفرم نظارت داشته و از تعاملات آنها با رباتهای مختلف آگاه شوند. این تغییرات با همکاری چندین کارشناس امنیت آنلاین نوجوان، از جمله سازمان ConnectSafely، در حال انجام است.

Character.AI، که توسط گروهی از مهندسان سابق گوگل تأسیس شده، به کاربران اجازه میدهد تا با رباتهای هوش مصنوعی سفارشی شده تعامل برقرار کنند. این رباتها طیف گستردهای از شخصیتها را پوشش میدهند، از مربیان زندگی گرفته تا شخصیتهای داستانی. با این حال، محبوبیت این پلتفرم در میان نوجوانان، نگرانیهایی را در مورد استفاده نادرست از آن ایجاد کرده است.

منتقدان زیادی چتبات Character.AI را به دلیل عدم ارجاع کاربران به منابع مرتبط با سلامت روان در هنگام بحث در مورد موضوعاتب مانند خودآزاری و خودکشی مورد انتقاد قرار دادهاند.

Character.AI در بیانیه مطبوعاتی خود اعلام کرده که در جریان است که رویکرد محافظتی آنها باید همگام با پیشرفت فناوری تکامل یابد. هدف این پلتفرم ایجاد فضایی برای خلاقیت و کاوش است، اما در عین حال باید ایمنی کاربران نیز تضمین شود.

ارسال دیدگاه